AI Act · RGPD · Code du travail · Applicable dès aujourd'hui

L'IA en entreprise

face au droit

La réglementation IA n'est pas une loi unique : c'est un empilement de textes déjà applicables. Ce guide pratique clarifie ce qui s'applique, à qui, à partir de quand — et ce que votre organisation doit concrètement faire.

Repères opérationnels pour encadrer les usages IA — sans se substituer à un conseil juridique.

Ce qui s'applique

depuis le 2 février 2025

L'AI Act est entré en vigueur progressivement. Certaines obligations sont déjà contraignantes — indépendamment du secteur ou de la taille de l'organisation.

L'AI Act impose depuis le 2 février 2025 une obligation d'AI literacy : les personnes utilisant ou supervisant des systèmes d'IA doivent disposer d'un niveau suffisant de compétence et de compréhension, adapté au contexte d'usage et au niveau de risque.

Cette obligation ne se réduit pas à faire lire une notice. Elle exige une formation réelle, proportionnée au rôle et aux usages concernés.

En parallèle, le RGPD et le Code du travail français s'appliquent pleinement à tout usage IA impliquant des données personnelles ou des salariés — sans attendre août 2026.

- AI literacy obligatoire pour les utilisateurs et superviseurs de systèmes IA

- Interdiction de la reconnaissance des émotions au travail par un système d'IA

- Interdiction de la manipulation comportementale et de la notation sociale

- Consultation obligatoire du CSE avant toute nouvelle technologie de contrôle

- Information préalable obligatoire des salariés sur tout dispositif de collecte de données

- Proportionnalité obligatoire de tout dispositif de surveillance (CNIL, 2024)

Systèmes à haut risque :

obligations renforcées le 2 août 2026

Les systèmes d'IA utilisés dans un contexte RH ou de contrôle des salariés entrent dans la catégorie "high-risk" au sens de l'AI Act — avec des obligations très concrètes pour l'entreprise déployeuse.

Tout système IA utilisé pour trier des candidatures, scorer des profils ou piloter des décisions de recrutement est classé high-risk.

Décisions automatisées ou assistées sur la promotion, l'affectation, la rémunération ou la rupture du contrat de travail.

Systèmes qui allouent des tâches sur la base du comportement, des traits personnels ou des performances passées.

Outils de monitoring, de scoring de performance, d'analyse comportementale ou de contrôle de l'activité des salariés.

Utiliser le système conformément aux instructions du fournisseur · assurer une supervision humaine réelle · garantir la qualité des données d'entrée · conserver les logs pendant au moins 6 mois · informer les représentants du personnel et les salariés concernés avant la mise en service · remonter les incidents aux autorités.

Et surtout : un droit à l'explication est ouvert lorsqu'une décision fondée sur un système IA à haut risque produit des effets juridiques ou affecte significativement la personne.

Ce que cela signifie

concrètement selon votre rôle

La responsabilité n'est pas uniforme. Elle dépend du rôle, des usages et des systèmes déployés dans votre organisation.

- Cartographier tous les usages IA de l'organisation et les classer par niveau de risque

- Interdire immédiatement les pratiques déjà prohibées (reconnaissance des émotions, manipulation)

- Mettre en place une politique interne d'usage : outils autorisés, données interdites, validations humaines obligatoires

- Désigner un responsable interne des usages IA (pas un titre formel, mais une responsabilité claire)

- Assumer : "c'est l'outil qui a décidé" ne dégage pas la responsabilité de l'employeur-déployeur

- Consulter le CSE avant l'introduction de tout outil IA impliquant le contrôle ou l'évaluation des salariés

- Informer les salariés de tout dispositif IA qui collecte des données les concernant

- Vérifier la proportionnalité des outils de surveillance — captures d'écran régulières et keyloggers sont en principe disproportionnés

- Ne jamais utiliser l'IA pour automatiser une décision discriminatoire (recrutement, rémunération, promotion, licenciement)

- Garantir une intervention humaine réelle sur toute décision à effets significatifs

- Réaliser une AIPD (analyse d'impact) pour tout traitement IA présentant un risque élevé pour les droits et libertés

- Vérifier la base légale RGPD de chaque traitement impliquant des données personnelles

- Appliquer l'article 22 du RGPD aux décisions entièrement automatisées à effets juridiques

- Exiger les logs des systèmes à haut risque conservés 6 mois sous contrôle de l'entreprise

- Documenter la conformité : base légale, finalité, durée de conservation, mesures de sécurité

Ce qui s'applique

à chaque usage IA impliquant des personnes

Même pour un usage "banal", dès qu'il y a des données personnelles, le RGPD et le droit du travail s'appliquent pleinement — sans attendre l'AI Act.

Tout traitement IA impliquant des données de salariés, candidats, clients ou prospects doit être licite, proportionné et documenté. La licéité suppose une base légale RGPD identifiée — consentement, exécution du contrat, intérêt légitime ou obligation légale.

Lorsqu'une décision est entièrement automatisée et produit des effets juridiques ou des effets significatifs sur une personne, l'article 22 du RGPD s'applique : droit de ne pas y être soumis par principe, droit à l'intervention humaine.

La CNIL rappelle qu'en télétravail comme en présentiel, l'employeur peut contrôler l'activité, mais seulement si le dispositif est strictement proportionné à l'objectif et ne porte pas une atteinte excessive aux droits et libertés.

L'employeur ne peut pas collecter des informations sur un salarié via un dispositif qui n'a pas été porté à sa connaissance au préalable. (Art. L1222-4 Code du travail)

Le CSE doit être consulté sur l'introduction de nouvelles technologies et sur les moyens de contrôle de l'activité des salariés, avant tout déploiement.

Une décision assistée par IA ne peut pas servir à contourner l'interdiction des discriminations dans le recrutement, la rémunération, la formation ou le licenciement. (Art. L1132-1 Code du travail)

L'employeur reste tenu par son obligation de protéger la santé physique et mentale des travailleurs — ce qui vise aussi les outils numériques créant une pression ou une surveillance excessive.

Des sanctions réelles,

cumulables et publiques

Les risques sont financiers, prud'homaux et réputationnels. Ils se cumulent et les décisions peuvent être rendues publiques.

ou 7 % du CA annuel mondial

Pour les manquements les plus graves : pratiques interdites, non-conformité des systèmes à haut risque. Amendes graduées selon la gravité.

ou 4 % du CA annuel mondial

Sanctions pouvant être rendues publiques. À cela s'ajoutent les risques prud'homaux et la nullité des mesures prises sur la base d'un dispositif illicite ou discriminatoire.

IA comme aide bureautique générique → gouvernance interne, RGPD et confidentialité sont les sujets principaux.

IA pour surveiller, trier, noter, orienter ou décider sur des personnes au travail → champ fortement réglementé, responsabilités directes et cumulées pour le chef d'entreprise.

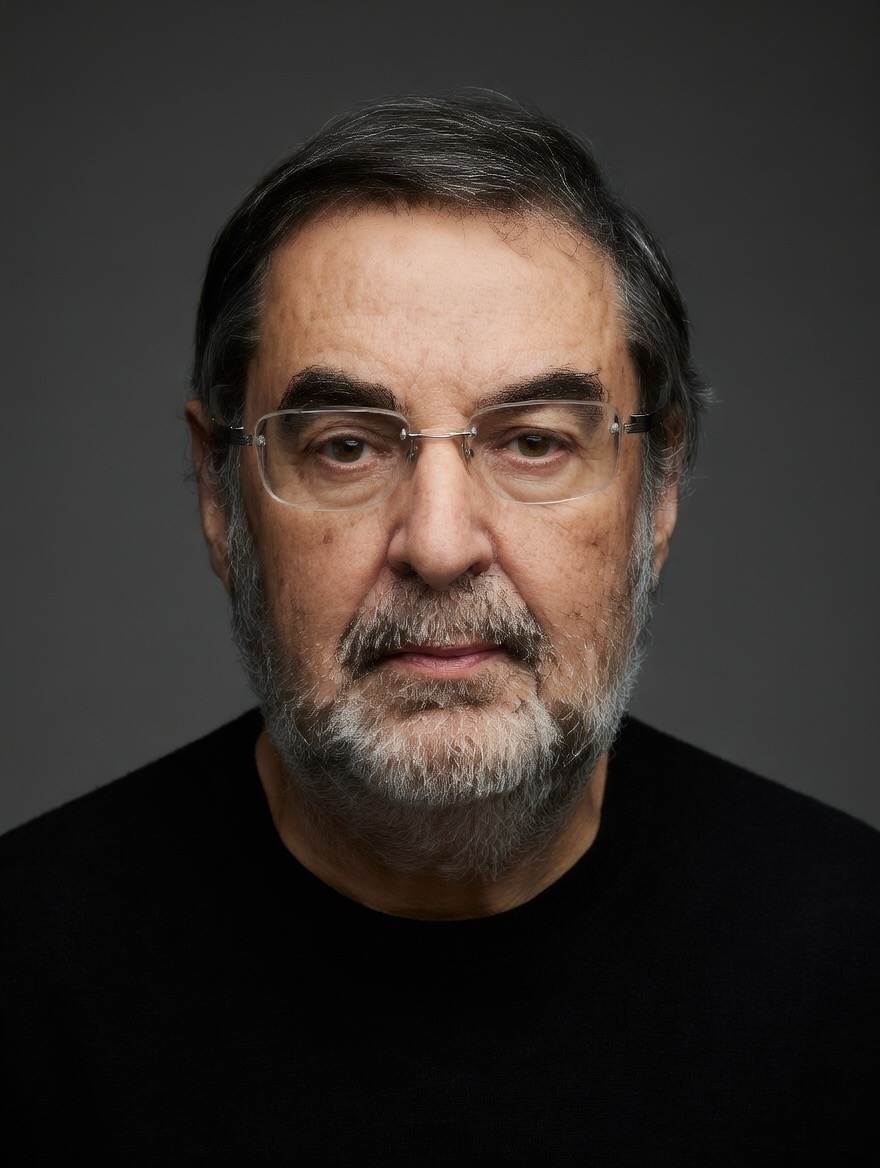

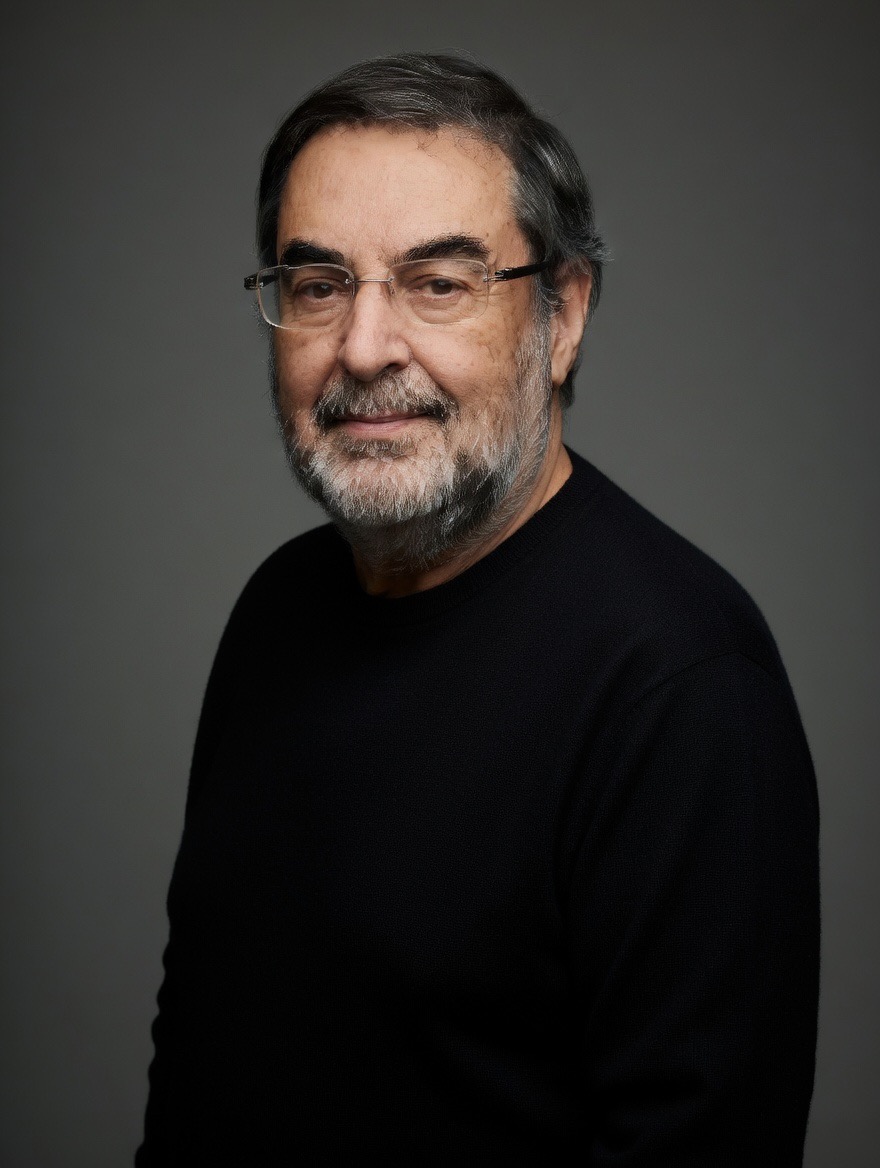

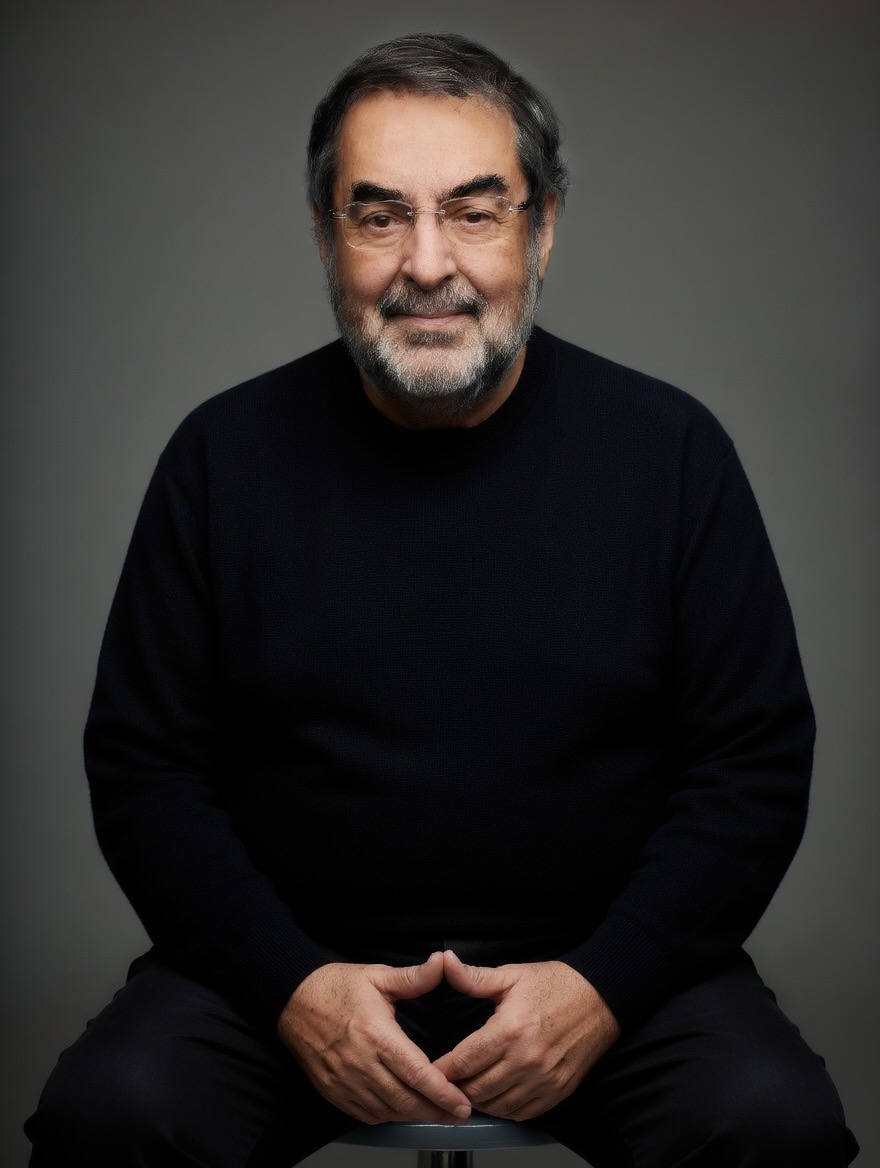

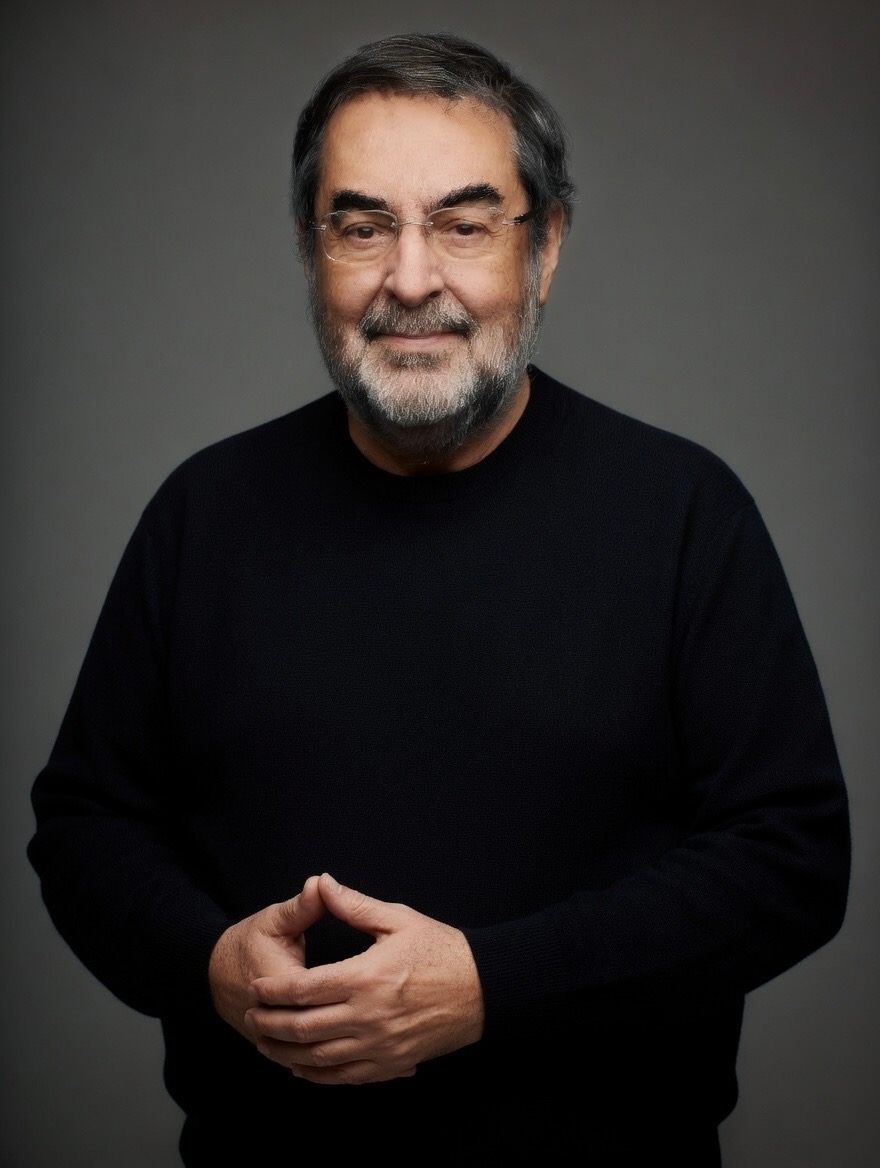

Cadrer les usages IA

de votre organisation

Cartographier vos usages, identifier ce qui est autorisé, encadré ou à proscrire, organiser l'AI literacy : je vous aide à structurer une gouvernance IA adaptée à votre contexte et à vos obligations.

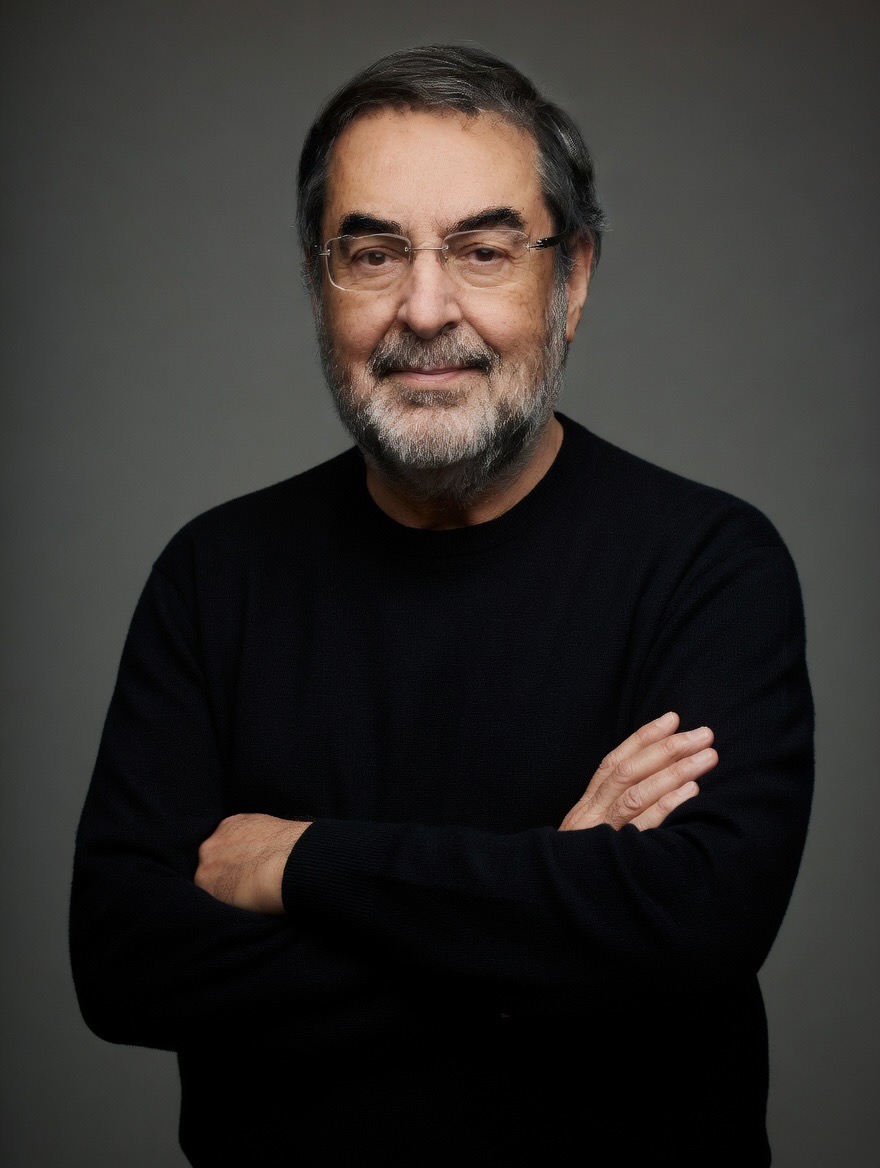

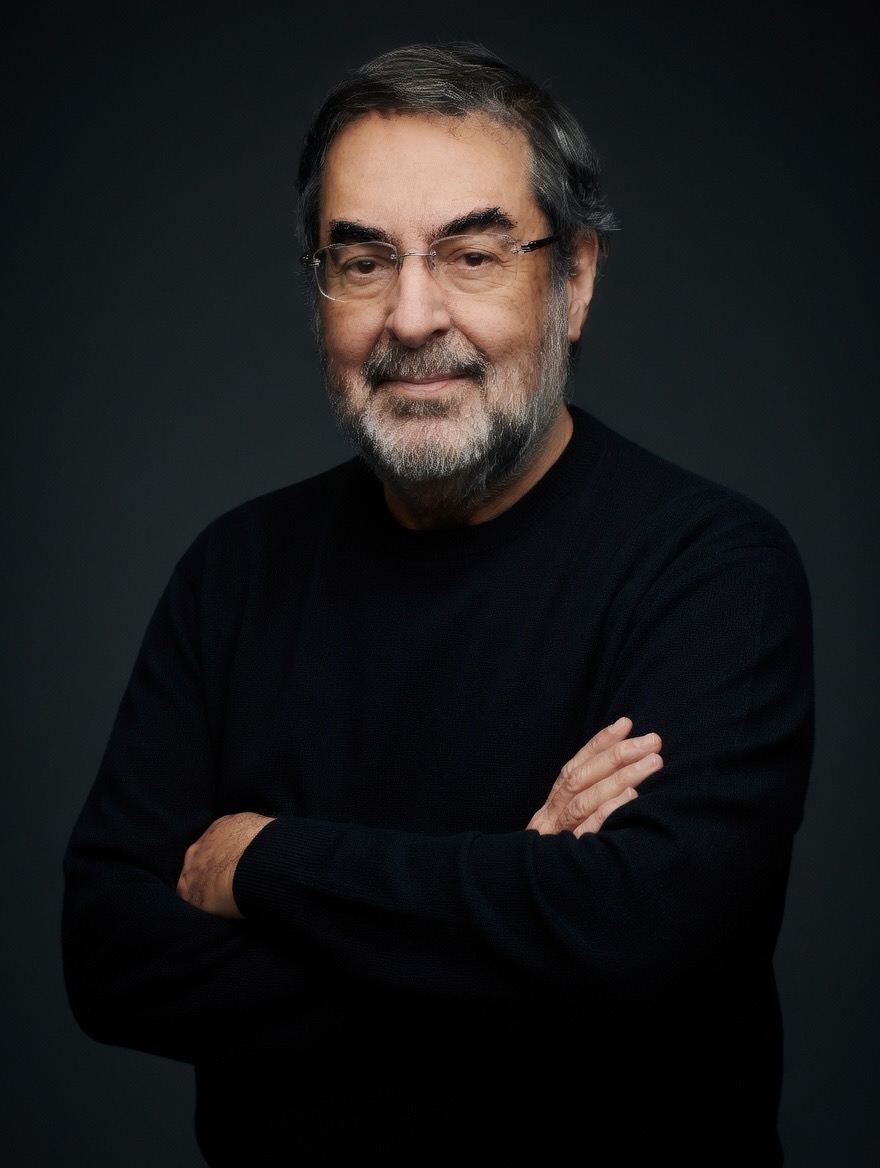

Aller plus loin

sur la réglementation IA

Synthèse des obligations clés, dates, responsabilités du déployeur et sanctions. Format PDF téléchargeable.

↓ TéléchargerIntégrer la dimension réglementaire dans la formation à l'IA. Pour les dirigeants, juristes et responsables conformité.

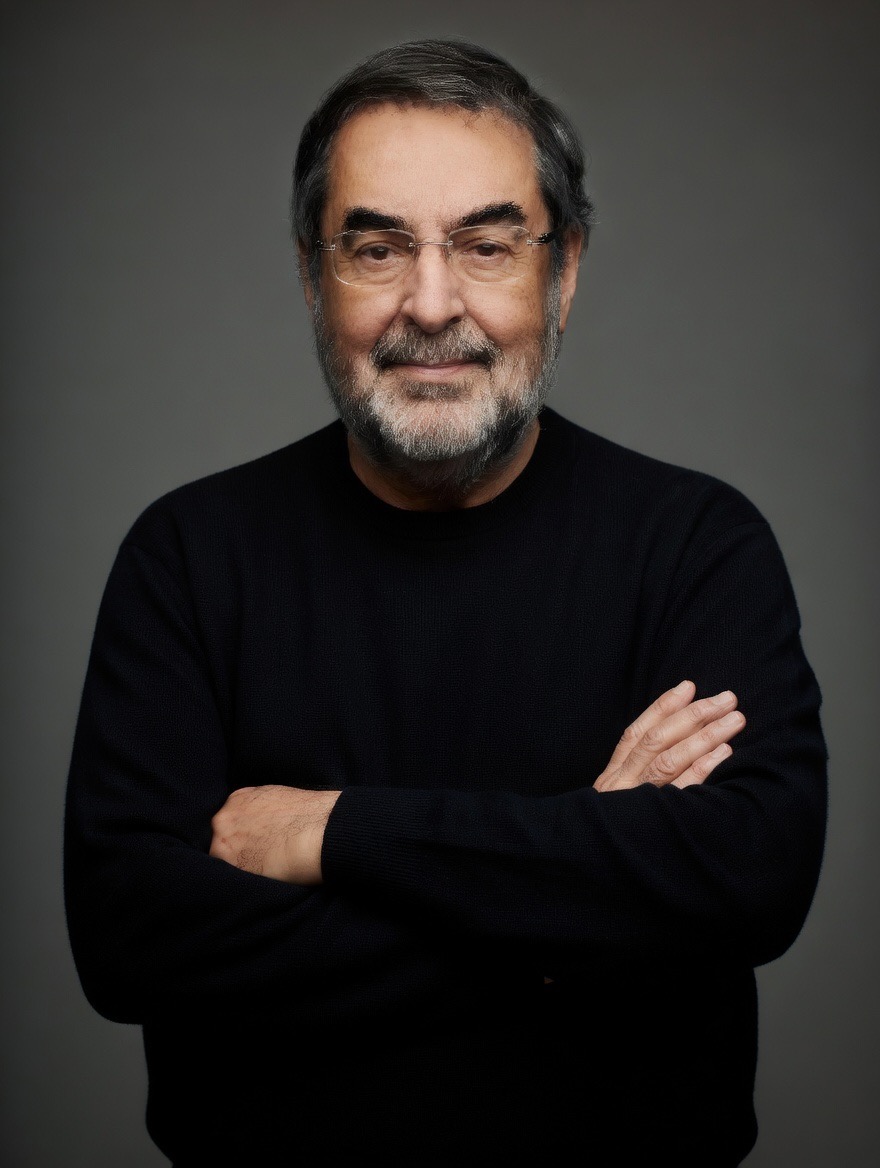

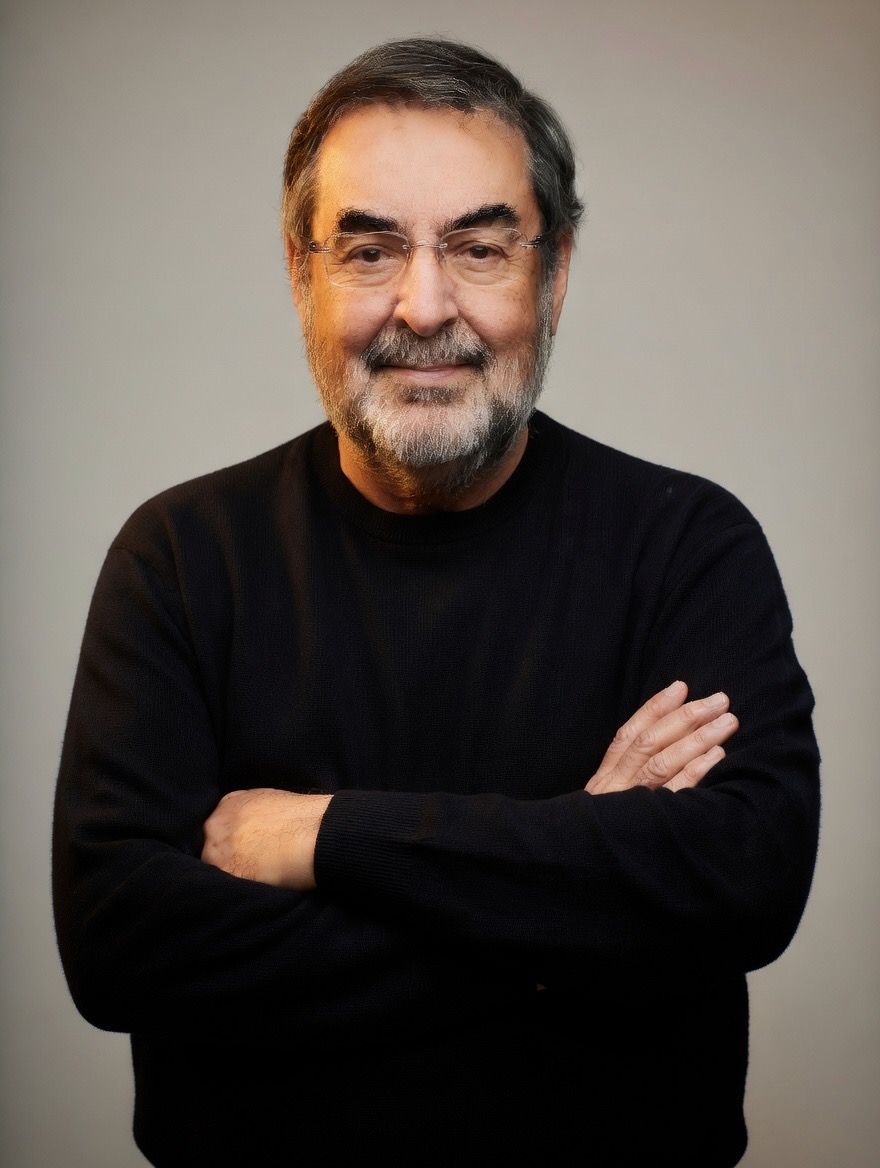

Voir les formations →Premier état des lieux de vos usages, classification par niveau de risque et recommandations adaptées à votre organisation.

Demander un diagnostic →